Bài viết này sẽ đi sâu vào cuộc cách mạng phát triển chip AI nội bộ của các tập đoàn công nghệ hàng đầu như Google, Amazon, Microsoft và Meta. Chúng ta sẽ cùng phân tích những động thái này đang định hình lại cục diện thị trường bán dẫn AI, thách thức vị thế của Nvidia như thế nào, và liệu đế chế GPU hùng mạnh này có thực sự lung lay trước những đối thủ đầy tham vọng.

1. Bước chuyển mình của Big Tech: Đầu tư mạnh mẽ vào chip AI nội bộ

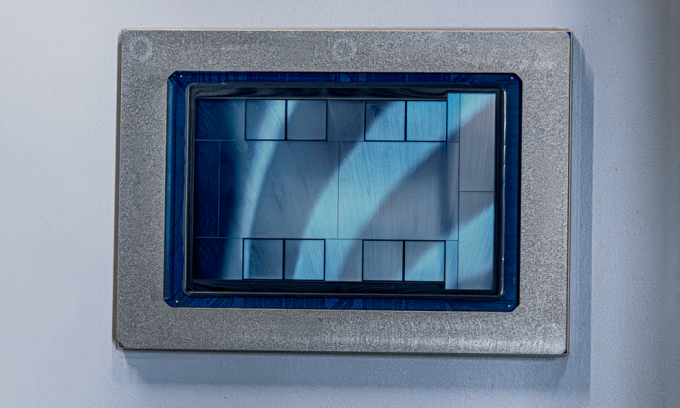

Google TPU: Từ “vũ khí bí mật” đến nền tảng thương mại hóa toàn diện

Google đã tiên phong trong cuộc đua phát triển chip AI nội bộ từ rất sớm, với sự ra đời của Bộ xử lý Tensor (TPU) từ năm 2015. Qua nhiều thế hệ phát triển, đặc biệt là kiến trúc Ironwood (TPU v7) tiên tiến, Google TPU đã vượt xa vai trò là một công cụ nghiên cứu nội bộ. Ngày nay, những con chip này không chỉ phục vụ nhu cầu tính toán khổng lồ của các mô hình AI tiên tiến như Gemini, mà còn trở thành một giải pháp cạnh tranh trực tiếp với GPU của Nvidia trên thị trường. Điểm khác biệt cốt lõi của TPU nằm ở việc nó được thiết kế tối ưu hóa chuyên biệt cho các phép toán đại số tuyến tính quy mô lớn – nền tảng của các siêu mô hình ngôn ngữ dựa trên kiến trúc Transformer. Điều này mang lại hiệu suất vượt trội và tiết kiệm năng lượng đáng kể so với các GPU đa dụng. Hơn nữa, Alphabet còn có bước đi chiến lược khi không chỉ sử dụng TPU cho hệ thống đám mây của mình mà còn mở rộng sang cung cấp nền tảng này cho các doanh nghiệp lớn. Điển hình là sự hợp tác với Anthropic, một trong những phòng thí nghiệm AI hàng đầu, cam kết sử dụng hàng triệu vi mạch TPU của Google cho việc huấn luyện và vận hành các mô hình Claude. Khả năng tự chủ toàn diện từ thiết kế vi mạch đến vận hành trung tâm dữ liệu đã giúp biên lợi nhuận mảng đám mây của Google tăng vọt, minh chứng rõ nét cho lợi ích tài chính từ chiến lược “tự cung tự cấp”. Chiến lược này không chỉ giúp Google giảm sự phụ thuộc vào Nvidia mà còn tạo ra một nguồn doanh thu mới đầy tiềm năng.

Amazon và Microsoft: Tái định hình cục diện điện toán đám mây

Không đứng ngoài cuộc chơi, Amazon Web Services (AWS) và Microsoft Azure cũng đang đẩy mạnh phát triển các vi mạch tùy chỉnh quy mô lớn. Tại Amazon, các dòng chip Trainium (dành cho huấn luyện) và Inferentia (dành cho suy luận) đã chứng kiến nhu cầu bùng nổ từ phía khách hàng doanh nghiệp. Amazon tự tin tuyên bố mảng kinh doanh chip nội bộ của họ đang đạt tốc độ tăng trưởng doanh thu ở mức ba con số, trở thành yếu tố then chốt để thu hút khách hàng rời bỏ các giải pháp đắt đỏ truyền thống. Đối với Microsoft, sự phụ thuộc vào Nvidia từng là một rào cản lớn khi họ phải đảm bảo hạ tầng cho hệ sinh thái Copilot và đối tác chiến lược OpenAI. Sự ra đời của dòng vi mạch tùy chỉnh Maia, với các phiên bản Maia 100 và Maia 200, là lời giải quyết liệt cho bài toán chi phí. Mặc dù Microsoft vẫn phải đầu tư hàng chục tỷ USD cho phần cứng Nvidia để đáp ứng nhu cầu trước mắt, việc triển khai song song chip Maia giúp họ tiết kiệm đáng kể chi phí điện năng và bảo trì cho các tác vụ hàng ngày. Điều này cực kỳ quan trọng trong việc bảo vệ dòng tiền của mảng dịch vụ AI đám mây đang chịu áp lực lớn về cơ sở hạ tầng. Cả hai tập đoàn này đang chứng tỏ khả năng cạnh tranh mạnh mẽ bằng cách cung cấp các giải pháp phần cứng AI được tối ưu hóa, mang lại lợi thế về chi phí và hiệu năng cho khách hàng của họ.

Meta MTIA: Tập trung chiến lược vào quá trình suy luận

Meta, dưới sự dẫn dắt của Mark Zuckerberg, lại có một cách tiếp cận mang tính thực dụng cao đối với phần cứng AI. Với hệ sinh thái mạng xã hội khổng lồ phục vụ hàng tỷ người dùng tương tác mỗi ngày, thách thức lớn nhất của Meta không chỉ là huấn luyện các mô hình AI nguồn mở như Llama mà còn là làm sao để vận hành các thuật toán đề xuất nội dung và chạy suy luận AI với chi phí điện năng và phần cứng thấp nhất. Dòng vi mạch MTIA (Meta Training and Inference Accelerator) ra đời chính xác để giải quyết mục tiêu này. Hiện tại, các thế hệ MTIA đang được Meta triển khai trên quy mô lớn, thay thế dần GPU Nvidia trong các trung tâm dữ liệu nội bộ. Các báo cáo phân tích độc lập chỉ ra rằng chi phí cho quá trình suy luận chiếm tới hai phần ba tổng lượng điện toán AI toàn cầu. Việc Meta hợp tác với các nhà gia công như Broadcom để thiết kế vi mạch chuyên biệt cho công đoạn này giúp họ tiết kiệm hàng tỷ USD chi phí mua sắm thiết bị. Hành động này được ví như một mũi dao sắc nhọn nhắm thẳng vào thị phần sinh lời nhất của các hãng sản xuất chip đa dụng, cho thấy chiến lược tập trung vào hiệu quả chi phí của Meta.

2. Ảnh hưởng đến thị trường và cuộc chơi của Nvidia

Sự trỗi dậy của chip AI tùy chỉnh: Lợi ích và thách thức

Việc Google, Amazon, Microsoft và Meta đồng loạt đổ hàng tỷ USD vào phát triển chip AI nội bộ đã tạo ra một làn sóng cạnh tranh mạnh mẽ, mang lại nhiều lợi ích nhưng cũng đặt ra những thách thức không nhỏ. Lợi ích rõ ràng nhất là sự tối ưu hóa về chi phí và hiệu năng. Các con chip AI được thiết kế riêng biệt cho từng tác vụ cụ thể sẽ mang lại hiệu suất cao hơn và tiêu thụ ít năng lượng hơn so với các GPU đa dụng. Điều này giúp các tập đoàn công nghệ lớn tiết kiệm hàng tỷ USD chi phí vận hành và đầu tư cơ sở hạ tầng. Hơn nữa, việc tự chủ về phần cứng giúp họ giảm sự phụ thuộc vào một nhà cung cấp duy nhất, giảm thiểu rủi ro về gián đoạn chuỗi cung ứng và linh hoạt hơn trong việc đáp ứng nhu cầu thị trường biến động. Tuy nhiên, thách thức cũng không nhỏ. Việc phát triển và sản xuất chip đòi hỏi nguồn vốn đầu tư khổng lồ, đội ngũ kỹ sư chuyên môn cao và thời gian nghiên cứu phát triển lâu dài. Bên cạnh đó, các dòng chip chuyên dụng (ASIC) có thể gặp hạn chế về khả năng tương thích và chuyển đổi sang các nền tảng khác, đòi hỏi chi phí kỹ thuật đáng kể nếu muốn thay đổi. Sự cạnh tranh gia tăng cũng đặt áp lực lớn lên Nvidia, buộc họ phải liên tục đổi mới để giữ vững vị thế dẫn đầu.

Hệ sinh thái phần mềm CUDA: Rào cản gia nhập của Nvidia

Một trong những yếu tố then chốt giúp Nvidia duy trì vị thế độc tôn trong nhiều năm qua chính là hệ sinh thái phần mềm CUDA (Compute Unified Device Architecture). Sau hơn hai thập kỷ phát triển, CUDA đã trở thành nền tảng quen thuộc và được sử dụng rộng rãi bởi hàng triệu lập trình viên trong cộng đồng trí tuệ nhân tạo trên toàn cầu. Khả năng tương thích rộng rãi với các framework AI phổ biến như TensorFlow, PyTorch giúp GPU của Nvidia duy trì tính linh hoạt cao trong cả nghiên cứu và triển khai. Điều này tạo ra một rào cản gia nhập đáng kể cho các đối thủ cạnh tranh. Các dòng chip AI tùy chỉnh, dù có thể vượt trội về hiệu năng cho từng tác vụ cụ thể, lại thường gặp khó khăn trong việc cạnh tranh với sự phổ biến và hệ sinh thái phát triển mạnh mẽ của CUDA. Việc chuyển đổi hoặc điều chỉnh phần mềm từ CUDA sang các nền tảng mới đòi hỏi nguồn lực và thời gian đáng kể, khiến nhiều doanh nghiệp và nhà nghiên cứu vẫn ưu tiên lựa chọn GPU của Nvidia cho các dự án mới. Đây là một lợi thế cạnh tranh mà các tập đoàn công nghệ lớn cần phải tìm cách khắc phục nếu muốn cạnh tranh sòng phẳng với Nvidia.

Tương lai của thị trường phần cứng AI: Đa dạng hóa hay tập trung?

Trong trung và dài hạn, thị trường phần cứng AI được dự báo sẽ chuyển dịch từ mô hình tập trung sang đa dạng nhà cung cấp. Nvidia nhiều khả năng vẫn sẽ giữ vai trò chủ đạo trong các lĩnh vực đòi hỏi tính linh hoạt cao như huấn luyện mô hình lớn và hạ tầng trung tâm dữ liệu đa dụng. Tuy nhiên, ở mảng triển khai ứng dụng và xử lý suy luận, các giải pháp chip AI tùy chỉnh từ Google, Amazon, Microsoft và Meta được kỳ vọng sẽ dần mở rộng thị phần. Sự cạnh tranh gia tăng này là động lực thúc đẩy đổi mới, buộc Nvidia phải liên tục cải tiến công nghệ để duy trì lợi thế. Đồng thời, nó cũng mang lại lợi ích cho các doanh nghiệp khi có nhiều lựa chọn về hạ tầng tính toán với chi phí hợp lý hơn. Trong bối cảnh đó, lợi ích lớn nhất sẽ thuộc về sự phát triển nhanh chóng của toàn bộ hệ sinh thái trí tuệ nhân tạo, thay vì chỉ tập trung vào một nhà cung cấp duy nhất. Sự đa dạng hóa này hứa hẹn một tương lai sôi động và đầy tiềm năng cho ngành công nghiệp chip AI.

3. Đánh giá chiến lược và triển vọng của các “ông lớn”

Google: TPU – Bước đi chiến lược tạo lợi thế cạnh tranh bền vững

Google đã có một bước đi vô cùng chiến lược khi đầu tư mạnh mẽ vào phát triển TPU từ sớm. Việc biến TPU từ một công cụ nội bộ thành một nền tảng thương mại hóa đã mang lại nhiều lợi ích cho tập đoàn. Thứ nhất, nó giúp Google giảm đáng kể chi phí vận hành các dịch vụ đám mây và AI của mình, đặc biệt là các mô hình ngôn ngữ lớn như Gemini. Thứ hai, việc cung cấp TPU cho các khách hàng doanh nghiệp khác mở ra một nguồn doanh thu mới đầy tiềm năng, đồng thời củng cố vị thế của Google Cloud trên thị trường. Khả năng tự chủ hoàn toàn từ phần cứng đến phần mềm giúp Google kiểm soát tốt hơn hiệu suất và chi phí, tạo ra một lợi thế cạnh tranh bền vững trước các đối thủ khác. Đặc biệt, với việc các mô hình Transformer ngày càng trở nên phổ biến, nhu cầu về các bộ xử lý tối ưu cho các phép toán đại số tuyến tính như TPU sẽ ngày càng tăng cao. Google đang tận dụng triệt để xu hướng này để khẳng định vị thế của mình.

Amazon và Microsoft: Cuộc đua giành thị phần đám mây bằng chip tùy chỉnh

Đối với Amazon và Microsoft, việc phát triển chip AI tùy chỉnh là một cuộc đua giành thị phần trong mảng điện toán đám mây đầy khốc liệt. AWS và Azure đều đang cố gắng thu hút và giữ chân khách hàng bằng cách cung cấp các giải pháp hạ tầng toàn diện, trong đó chip AI nội bộ đóng vai trò then chốt. Chip Trainium và Inferentia của Amazon, hay chip Maia của Microsoft, đều được thiết kế để tối ưu hóa cho các tác vụ AI cụ thể, mang lại hiệu suất vượt trội và chi phí cạnh tranh so với việc sử dụng GPU của Nvidia. Điều này đặc biệt quan trọng khi nhu cầu về AI ngày càng tăng cao, đòi hỏi các nhà cung cấp dịch vụ đám mây phải tối ưu hóa chi phí vận hành. Bằng cách giảm bớt sự phụ thuộc vào Nvidia, Amazon và Microsoft có thể kiểm soát tốt hơn giá cả và nguồn cung, đồng thời tạo ra các gói dịch vụ hấp dẫn hơn cho khách hàng. Cuộc cạnh tranh này không chỉ mang lại lợi ích cho người dùng cuối mà còn thúc đẩy sự đổi mới trong toàn ngành công nghiệp bán dẫn AI.

Meta: Ưu tiên hiệu quả chi phí cho quy mô người dùng khổng lồ

Chiến lược của Meta với dòng chip MTIA là một minh chứng rõ nét cho việc ưu tiên hiệu quả chi phí khi phục vụ một lượng người dùng khổng lồ. Với hàng tỷ người dùng tương tác trên các nền tảng của Meta mỗi ngày, chi phí vận hành các thuật toán đề xuất nội dung và suy luận AI là một gánh nặng không nhỏ. Việc phát triển MTIA giúp Meta giải quyết bài toán này bằng cách tập trung vào tối ưu hóa cho các tác vụ suy luận, vốn chiếm phần lớn chi phí điện toán AI. Thay vì đầu tư vào các GPU đa dụng đắt đỏ, Meta có thể triển khai các chip MTIA trên quy mô lớn với chi phí hợp lý hơn, giúp tiết kiệm hàng tỷ USD. Điều này cho phép Meta tiếp tục đầu tư vào các lĩnh vực khác như phát triển mô hình AI nguồn mở, đồng thời duy trì khả năng cạnh tranh trong một môi trường ngày càng khốc liệt. Sự tập trung vào hiệu quả chi phí của Meta cho thấy một hướng đi thông minh, đặc biệt khi các công ty tìm cách mở rộng quy mô AI của mình.